Geposted in Teams, People & Culture, Künstliche Intelligenz.

Das Team, das wir kannten, gibt es nicht mehr

Geschrieben von ETB - Empowerment Team Berlin am .

KI als Teammitglied steigert die Performance – und erschüttert, was es bedeutet, Mensch im Team zu sein.

Ein ganz normaler Jour fixe. Fast.

Es ist 9:30 Uhr. Fünf Personen haben sich in einer Videokonferenz versammelt: zwei in Frankfurt, eine in Singapur, einer auf einem Pendlerzug irgendwo zwischen München und Augsburg. Das ist der übliche Anblick eines modernen Teams: verteilt, international, hybrid. Doch an diesem Morgen ist noch jemand dabei. Kein Mensch, keine Kamera, kein Mikrofon. Und dieser Teilnehmer hat in der Nacht gearbeitet als die anderen schliefen.

Er hat das Protokoll der letzten Sitzung ausgewertet, drei Marktanalysen verglichen, eine Entscheidungsvorlage erstellt und drei Szenarien durchgespielt – inklusive der Risikobewertung. Sein Name steht im Kalender wie der jedes anderen Teammitglieds: „Strategic Horizon, Strategy Agent”, von vielen einfach Hori genannt.

CEO, Marie fragt: „Habt ihr die Prognose von Hori gelesen?“ Alle nicken. „Wir haben echten Handlungsbedarf. Lasst uns mal die Handlungsoptionen durchgehen, die Hori generiert hat.“

Teams, die wir so noch nicht kennen, entstehen gerade überall, nicht in Zukunftslaboren, sondern in ganz normalen Unternehmen und ganz normalen Meetings.

Wir selbst stehen in einem Echtzeit-Labor und können beobachten, wie schnell und fundamental sich unsere Arbeitswelt verändert. Und es ist längst noch nicht klar, was es bedeutet, Mitglied eines Teams zu sein, in dem nicht alle Mitglieder Menschen sind. Das kann sich manchmal ungemütlich anfühlen.

1. Eine neue Art von Team

Vom hybriden zum multimodalen Team

„Hybride Teams“ sind spätestens seit COVID weit verbreitet. Manchmal ist es schlicht die Mischung aus Büro- und Homeoffice-Arbeit. Manchmal wird der Begriff auch auf internationale Teams ausgeweitet. Dass Menschen an verschiedenen Orten, in verschiedenen Zeitzonen, aus verschiedenen Kulturen und zu verschiedenen Zeiten arbeiten ist mittlerweile normaler Alltag. Wir haben uns daran gewöhnt, auch wenn es hin und wieder schwer wird, hybride Teams zu managen und kulturelle Unterschiede nicht zu Störfaktoren werden zu lassen.

Derzeit wird das Team-Management noch anspruchsvoller. Teams sind nicht mehr nur hybrid, sondern werden zunehmend multimodal. Was in den Organisationsforschungslaboren der Welt unter dem Begriff „Human-AI Teams” (HAITs) untersucht wird, ist eine qualitativ deutlich andere Form der Zusammenarbeit. KI-Systeme sind nicht mehr nur Werkzeuge. Sie agieren als aktive Teammitglieder, die eigene Aufgaben übernehmen, Entscheidungen beeinflussen – manchmal sogar selbst treffen und umsetzen – und damit Prozesse grundlegend verändern.

Der entscheidende Unterschied zu bisheriger Software liegt in dem, was „Agency“ genannt wird. Auf Deutsch umfasst dieser Begriff eine Mischung aus „Handlungsfähigkeit“, „Autonomie“ und „Wirkmächtigkeit“. Was heißt das? Ein klassisches Analysetool wartet, bis ein Mensch es bedient. Ein moderner KI-Agent plant selbstständig, delegiert Unteraufgaben, lernt aus Feedback und kommuniziert seine Zwischenergebnisse – er verhält sich, strukturell betrachtet, wie ein Teammitglied (Lou et al., 2025).

Was ist ein KI-Agent – und was unterscheidet ihn von einer KI-Anwendung?

Eine KI-Anwendung führt aus, was ein Mensch veranlasst. Ein KI-Agent plant, entscheidet und handelt eigenständig auf ein Ziel hin. Er kann mehrschrittige Prozesse orchestrieren, Tools nutzen, Zwischenergebnisse bewerten und iterieren. Moderne Agenten basieren auf großen Sprachmodellen (LLMs) und sind in der Lage, Aufgaben zu übernehmen, die bis vor Kurzem ausschließlich hochqualifizierten Fachkräften vorbehalten waren (Lou et al., 2025).

Multimodale Team sind also Konstellationen, in denen Kompetenz, Aufmerksamkeit und Verantwortung auf menschliche und nicht-menschliche Akteure verteilt sind. Der Begriff ist bewusst gewählt: „Multimodal” verweist nicht auf Technologie, sondern auf eine grundlegend neue Teamarchitektur.

Ein reales Beispiel: GitHub Copilot und der Beginn des einsamen Entwicklers

Eines der am besten dokumentierten Beispiele für multimodale Teams stammt aus der Softwareentwicklung. GitHub Copilot, ein KI-System, das Code-Vorschläge in Echtzeit generiert, hat in großen Entwicklerteams weltweit eine neue Arbeitsteilung etabliert: Menschen definieren Absichten, formulieren Architekturen, reviewen und entscheiden. Der KI-Agent schreibt, testet und schlägt vor. So lässt sich Pair Programming mit einem einzigen Entwicklungsingenieur realisieren.

Eine Studie von Peng und Kollegen (2023) zeigte, dass erfahrene Entwicklerinnen und Entwickler KI-generierten Code deutlich effektiver integrierten als Berufsanfänger – die Synergiewirkung hängt also stark von der menschlichen Expertise ab, die das KI-Angebot bewertet und filtert. Dieser Befund ist symptomatisch für eine breitere Erkenntnis: Multimodale Teams entfalten ihr Potenzial nicht automatisch, sondern nur unter bestimmten, von Menschen abhängigen Bedingungen.

Je wirksamer solche KI-Assistenten werden, desto mehr kann eine einzelne Person mit ihrer Hilfe erreichen. Das Szenario, dass ein einziger Entwickler eine Vielzahl von Coding-Agenten orchestriert ist real. Dabei schrumpft die menschliche Seite des Teams auf diese eine Person. Mit Sicherheit ein Risiko für Einsamkeitserfahrungen.

2. Das Versprechen: Warum es funktionieren kann

Komplementarität als Kernprinzip

Warum sollten Teams mit KI besser sein als Teams ohne? Die intuitive Antwort, „weil KI mehr und schneller rechnen kann,” greift zu kurz. Der tiefere Grund ist struktureller Natur: Menschen und KI-Agenten sind komplementär. Sie sind gut in verschiedenen Dingen, und diese Verschiedenheit kann produktiv sein.

Menschen bringen kontextuelles Verständnis, implizites Erfahrungswissen, moralisches Urteil und emotionale Intelligenz. KI-Agenten können große Datenmengen verarbeiten, Informationsasymmetrien im Team ausgleichen, konsistent verfügbar sein und ohne Ermüdung operieren (Zercher et al., 2025). Die Stärke des multimodalen Teams liegt genau in dieser Spannung: Was dem einen fehlt, liefert der andere.

Berretta und Kolleginnen von der Ruhr-Universität Bochum fassen es präzise zusammen: Die Grundvoraussetzungen für funktionierende Mensch-KI-Synergien liegen in vier Bedingungen.

- KI-Fähigkeiten und -Design, die zum Team passen

- KI-Verständnis und Kompetenz aufseiten der Menschen

- Geeignete Prozesse auf Teamebene

- Gemeinsame mentale Modelle und Situationsbewusstsein

Der menschliche Teil muss das Verhalten der KI verstehen und antizipieren können. Erst dann entstehen echte Synergien – und keine bloße Koexistenz. So kann Vertrauen untereinander und in Systeme entstehen (Berretta et al., 2023).

Entscheidungsqualität in der Praxis

Der vielleicht überzeugendste Beleg für das Versprechen multimodaler Teams kommt aus der Medizin. Radiologieteams, die KI-gestützte Diagnosesysteme in ihre Befundprozesse integriert haben, zeigen in mehreren Studien konsistent bessere Ergebnisse als rein menschliche Teams: weniger übersehene Befunde, schnellere Entscheidungszeiten, weniger Varianz zwischen Gutachtern.

Der entscheidende Punkt: Nicht die KI allein entscheidet besser. Und nicht der Mensch allein. Sondern der Mensch, der weiß, wann er dem KI-Vorschlag vertrauen kann – und wann nicht (Zercher et al., 2025). Das ist ein Paradigmenwechsel. Kompetenz verschiebt sich von der Fachkenntnis hin zur Metakompetenz – der Fähigkeit, mit KI-Partnern zu kooperieren.

McKinsey hat in seinem jüngsten Skill-Partnerships-Report berechnet, dass KI-gestützte Agenten und Roboter in einem mittleren Adoptionsszenario bis 2030 rund 2,9 Billionen US-Dollar an wirtschaftlichem Wert pro Jahr allein in den USA freisetzen könnten – jedoch nur, wenn Organisationen ihre Mitarbeitenden vorbereiten und ganze Workflows neu gestalten, statt nur einzelne Aufgaben zu automatisieren (McKinsey, 2025).

3. Die Schattenseite: Was auf dem Spiel steht

Das Motivationsparadox

Im Frühjahr 2025 veröffentlichte eine Forschungsgruppe um Jialin Li eine Studie in Scientific Reports, die in der Forschungsgemeinschaft erhebliche Aufmerksamkeit erzeugte. Die Kernaussage war so klar wie beunruhigend: Mensch-KI-Kollaboration verbessert die unmittelbare Aufgabenleistung – aber sie untergräbt die intrinsische Motivation der Mitarbeitenden (Li et al., 2025).

Die Erklärung ist psychologisch plausibel: Wenn KI die analysierenden, gestaltenden, kreativ-anspruchsvollen Teile einer Aufgabe übernimmt – genau jene Anteile, die Menschen als bedeutsam erleben –, verliert die Arbeit an innerer Motivationskraft. Das Ergebnis stimmt, der Prozess ist effizienter, aber das Erleben ist ärmer. Auf Dauer gefährdet das das Engagement – vielleicht nicht im nächsten Quartal, aber im nächsten Jahr.

Isolation, Erschöpfung, Überflüssigkeit

Ein weiterer Befund der jüngeren Forschung verdient besondere Aufmerksamkeit: KI-Kollaboration kann soziale Isolation verstärken. Wenn Mitarbeitende mehr mit KI interagieren als mit Kollegen, verändert sich die Qualität ihres Arbeitslebens subtil, aber spürbar. Studien berichten von Gefühlen der Einsamkeit, emotionaler Erschöpfung und, in extremen Fällen, depressiven Symptomen (Lee et al., 2025).

Eine koreanische Langzeitstudie mit 381 Mitarbeitenden zeigte, dass KI-Einführung die psychologische Sicherheit im Team signifikant reduzieren kann – ein Befund, der für HR-Verantwortliche besonders alarmierend sein sollte, da psychologische Sicherheit eine der robustesten Prädiktoren für Teamleistung ist (Lee et al., 2025).

Mehr Arbeit trotz gestiegener Effizienz

Ranganathan und Ye warnen: Was als höhere Produktivität erscheint, kann eine schleichende Zunahme der Arbeitsbelastung, Ermüdung, geschwächte Entscheidungsfähigkeit und schließlich Burnout oder Fluktuation verschleiern (Ranganathan & Ye, 2026).

In einer achtmonatigen ethnografischen Studie fanden die Autorinnen heraus, dass KI dazu führte, dass KI zusätzliche Arbeit zugänglich werden, effizient und sogar lohnend erscheinen ließ, was die Mitarbeiter dazu ermutigte, ihren Aufgabenbereich zu erweitern, anstatt Aufgaben zu ersetzen oder zu eliminieren. Die Produktivität stieg zunächst sprunghaft an, ohne dass sich der Arbeitsaufwand oder die Arbeitszeit entsprechend verringerten, was zu den geschilderten negativen Konsequenzen führen kann.

4 Mensch und KI im Team

Kehren wir zurück zu dem Jour fixe vom Anfang.

Hori – Strategy Agent – hat seine Arbeit getan. Die Analysen liegen vor, die Szenarien sind durchgespielt, die Entscheidungsvorlage steht. Das Team diskutiert.

Und dann passiert etwas, das außerhalb der Fähigkeiten von Hori liegt: Eine der Teilnehmerinnen fragt: „Haben wir eigentlich die Auswirkungen auf unser Team in Asien bedacht? Die haben gerade eine schwierige Phase.” Ein anderer sagt: „Ich glaube, wir unterschätzen, wie diese Entscheidung von unseren Kunden wahrgenommen wird – emotional, meine ich.” Die Runde schweigt kurz. Dann beginnt ein Gespräch, das keine KI antizipieren kann.

Genau dieser Wechsel der Perspektiven und das damit verbundene Mindset machen einen Unterschied. KI ist nicht per se bedrohlich, aber auch nicht per se harmlos. KI kann vieles eigenständig erledigen. Und was übrigbleibt, ist das Schwierigste und Wertvollste, nämlich das Menschliche: Urteil, Empathie, Verantwortung, Bedeutung.

Für Führungskräfte und HR-Verantwortliche ergibt sich eine klare Agenda, wenn Teams und KI enger zusammenwachsen:

- Multimodale Teams sind keine Zukunftsmusik, sondern Gegenwart – wer sie ignoriert, verliert.

- Technologie allein entscheidet nicht über Erfolg oder Scheitern, sondern die Qualität der menschlichen Führung, Begleitung und Gestaltung.

- Die wichtigste Investition ist nicht die in bessere KI-Tools, sondern in Menschen, die wissen, wie man mit ihnen arbeitet, und die trotzdem wissen, was sie ohne sie können.

- Teams brauchen Unterstützung beim Start, bei der Entwicklung eines eigenen KI-integrierenden „Way of Working“ und an weiteren wichtigen Wegpunkten .

Das Team, das wir kannten, gibt es nicht mehr. Das Team, das entstehen kann, könnte besser sein als alles, was wir bisher kannten. Aber nur, wenn wir es bewusst gestalten.

Quellenangaben und weiterführende Literatur

Berretta, S., Tausch, A., Ontrup, G., Gilles, B., Peifer, C. & Kluge, A. (2023). Defining human-AI teaming the human-centered way: a scoping review and network analysis. Frontiers in Artificial Intelligence, 6. https://doi.org/10.3389/frai.2023.1250725

Lee, S. et al. (2025). The dark side of artificial intelligence adoption: linking AI adoption to employee depression via psychological safety and ethical leadership. Humanities and Social Sciences Communications. https://www.nature.com/articles/s41599-025-05040-2

Li, J. et al. (2025). Human-generative AI collaboration enhances task performance but undermines human’s intrinsic motivation. Scientific Reports. https://www.nature.com/articles/s41598-025-98385-2

Lou, B. et al. (2025). Unraveling Human–AI Teaming: A Review and Outlook. arXiv preprint. https://arxiv.org/abs/2504.05755

McKinsey Global Institute (2025). Agents, robots, and us: Skill partnerships in the age of AI. https://www.mckinsey.com/mgi/our-research/agents-robots-and-us-skill-partnerships-in-the-age-of-ai#/.

Peng, S. et al. (2023). The Impact of AI on Developer Productivity: Evidence from GitHub Copilot. https://doi.org/10.48550/arXiv.2302.06590.

Zercher, F. et al. (2025). How Can Teams Benefit From AI Team Members? Journal of Organizational Behavior. https://doi.org/10.1002/job.2898

Vielleicht mögen sie auch

-

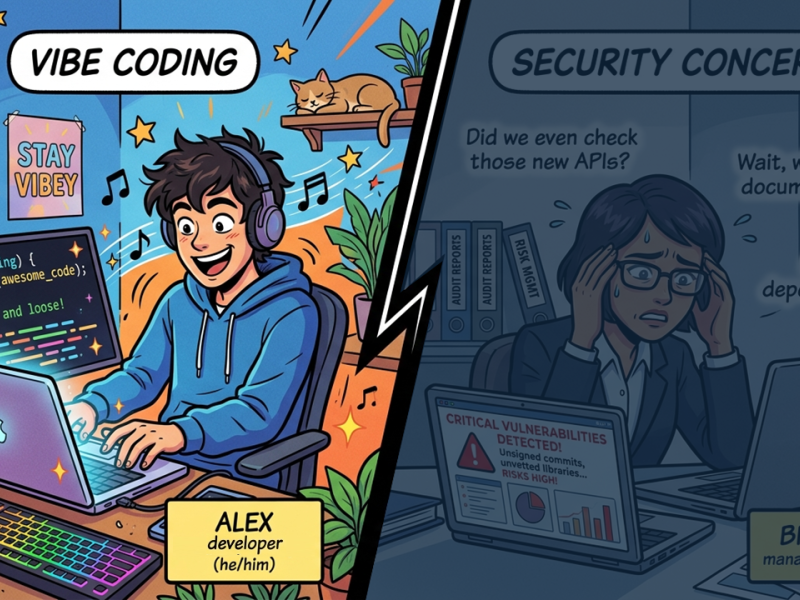

Vibe Coding? Klar, aber strategisch!

- Geschrieben von Uwe Weinreich

- Veröffentlicht am

-

Wie führen, wenn ein Teil des Teams nicht mehr führbar ist?

- Geschrieben von ETB - Empowerment Team Berlin

- Veröffentlicht am

-

Vergesst Team Coaching, wenn das Setup nicht stimmt!

- Geschrieben von ETB - Empowerment Team Berlin

- Veröffentlicht am

-

Das Automatisierungsparadoxon

- Geschrieben von Uwe Weinreich

- Veröffentlicht am

-

Die 7+1 Elemente von High-Perfomance Teamwork

- Geschrieben von ETB - Empowerment Team Berlin

- Veröffentlicht am